איומי אבטחת מידע – כיצד איומים שמונעים על ידי בינה מלאכותית משנים את נוף אבטחת הסייבר

התפתחות איומי הסייבר בעידן הבינה המלאכותית

עם התקדמות הטכנולוגיות בתחום בינה מלאכותית, חלה גם עלייה משמעותית בתחכום של איומי סייבר. בעבר, רוב התוקפים השתמשו בכלים ותכסיסים יחסית מוגבלים, אך כיום הפוטנציאל של איומי בינה מלאכותית לשבש ולפגוע במערכות דיגיטליות הוא חסר תקדים. באמצעות אלגוריתמים חכמים, תוקפים יכולים לנתח כמויות גדולות של נתונים, לזהות חולשות אבטחה ולהתאים את התקיפה כך שתהיה ממוקדת ואפקטיבית יותר.

מגמה אחת מרכזית היא השימוש בלמידת מכונה כדי ליצור התקפות מדויקות יותר. תוקפים יכולים לאמן מודלים מתוחכמים המסוגלים ללמוד דפוסי פעילות תקינים של מערכות וארגונים, ולאחר מכן להתחזות לתעבורה לגיטימית תוך הימנעות מזיהוי על ידי מערכות אבטחה מסורתיות. בכך, ניתן לבצע פריצה בלתי מזוהה כמעט לחלוטין, מה שמאתגר עוד יותר את מומחי אבטחת סייבר.

יתרה מכך, השימוש במודלים שפותחו למטרות חיוביות, כמו זיהוי דיבור, הבנת טקסט וניתוח תמונות, הופך גם לכלי בחזקת התוקפים. לדוגמה, ניתן להשתמש במערכות לזיוף קולית (deepfake) כדי להתחזות לאנשים אמיתיים, להשיג הרשאות גישה רגישות ולבצע הונאות מתוחכמות. כמו כן, מנועי ניתוח התנהגותיים מבוססי AI מאפשרים לתוקפים להבין דפוסי משתמשים ולחזק את מנגנוני ההתחזות שלהם.

באופן כללי, המעבר לעבר תקיפות מבוססות AI מציב אתגרים חדשים ומשמעותיים בפני ארגונים וגורמי הגנה. כדי להתמודד עם התפתחויות אלה, יש צורך בפיתוח כלים וטכנולוגיות חדשות שיספקו מענה הולם להשתנות הבלתי פוסקת של האיומים בעולם הדיגיטלי.

שיטות מתקדמות לתקיפה מבוססת בינה מלאכותית

עם התפתחות היכולת של מערכות בינה מלאכותית לנתח מידע ולהסתגל במהירות לסביבות משתנות, גם שיטות התקיפה נעשות מתוחכמות יותר. בעוד שבעבר תוקפים היו תלויים בעיקר בטכניקות מסורתיות כמו ניסיונות פריצה פשוטים או התקפות פישינג, כיום נעשה שימוש באלגוריתמים חכמים כדי לבצע תקיפות מתוחכמות המבוססות על ניתוחי נתונים והבנת חולשות של מערכות שונות.

אחת השיטות המתקדמות כוללת שימוש בלמידת מכונה כדי לחדד את יכולות התקיפה. על ידי הזנת כמויות גדולות של נתונים למודלים מתקדמים, תוקפים יכולים לזהות דפוסים שמאפשרים להם לעקוף מנגנוני אבטחת סייבר. לדוגמה, מודלים אלו יכולים לנתח תגובות של מערכות הגנה ולהתאים את ההתקפה בזמן אמת כך שהסיכוי לזיהוי יהיה מינימלי. באמצעות למידת מכונה, ניתן להפעיל מתקפות ממוקדות המתאימות את עצמן להגנות של הקורבן בצורה מתוחכמת.

שיטה נוספת אשר צוברת תאוצה היא שימוש בטכניקות מניפולציה מתקדמות של קוד זדוני המופעל באמצעות AI. קבצים זדוניים עוברים אופטימיזציה מתמדת כך שיוכלו לחמוק מגילוי על ידי אנטי-וירוסים ומערכות למניעת חדירות. בנוסף, נעשה שימוש בדור חדש של נוזקות אשר משנות את קודן לאחר הפעלה (polymorphic malware), מה שמונע זיהוי מבוסס חתימות.

כמו כן, תוקפים מרבים להשתמש במערכות AI כדי לבצע ניתוח מעמיק של חולשות במערכות ארגוניות ולתכנן את דרך החדירה היעילה ביותר. במקום לסרוק ידנית רשתות מחשבים ולאתר פרצות, אלגוריתמים חכמים מבצעים סריקות אוטומטיות ומזהים חריגות המצביעות על נקודות תורפה פוטנציאליות. בכך, מתקפות הופכות מדויקות וממוקדות יותר, וחוסכות לתוקפים זמן ומאמץ ניכר.

מגמה נוספת היא השימוש באיומי בינה מלאכותית כדי לבצע התקפות כוח גס (brute force) מתוחכמות יותר. מודלים חכמים יכולים לחזות סיסמאות אפשריות בהתבסס על מידע אישי שנאסף מהרשת ולצמצם משמעותית את הזמן הנדרש לפיצוחן. יכולות אלו מקשות על ההגנה המסורתית ומתמרצות את הצורך בפתרונות חדשניים להגנה על חשבונות ונתונים רגישים.

התקפות אלו מדגימות כיצד בינה מלאכותית משנה את שדה הקרב הדיגיטלי, תוך שהיא מספקת לתוקפים יתרון משמעותי בהתמודדות עם מנגנוני האבטחה הקיימים. כדי להתמודד עם השתדרגות זו, ארגונים חייבים לאמץ גישות פרו-אקטיביות יותר, לרבות שימוש בטכנולוגיות מבוססות AI לזיהוי התנהגות חשודה והקמת מערכות אשר לומדות ומשתפרות באופן מתמשך כדי להדוף את האיומים העתידיים.

התחזות והנדסה חברתית באמצעות אלגוריתמים חכמים

בעידן שבו הטכנולוגיה מתקדמת בקצב מהיר, איומי בינה מלאכותית משנים את כללי המשחק בתחום ההנדסה החברתית. אחד האיומים המרכזיים שמקבל תאוצה הוא שימוש באלגוריתמים חכמים לטובת התחזות מתוחכמת ושכנוע משתמשים למסור מידע רגיש. אם בעבר התקפות כאלו נשענו בעיקר על הודעות דוא"ל מזויפות או מתקפות פישינג סטנדרטיות, הרי שהיום יכולות למידת מכונה מאפשרות ליצור הודעות ומסרים שמותאמים אישית לכל קורבן.

אחת הדרכים שבהן נעשה שימוש באלגוריתמים חכמים היא יצירת הודעות מזויפות על בסיס מידע שנאסף מרשתות חברתיות ומקורות פתוחים (OSINT). באמצעות ניתוח שפה מתקדם ומודלים המדמים סגנון כתיבה אנושי, ניתן ליצור הודעות שנראות כאילו הן נכתבו על ידי עמית לעבודה או מנכ"ל הארגון, וכך להגדיל את הסיכוי שהקורבן יפעל בהתאם להנחיות המזויפות.

מעבר לכך, אבטחת סייבר מתמודדת עם האיום של זיוף קול ותמונה (deepfake), המאפשר לתוקפים ליצור סרטונים והודעות קוליות שנראים או נשמעים בדיוק כמו גורמים רשמיים. כך למשל, ניתן לייצר שיחות קוליות מזויפות של מנהלים בכירים שמבקשים מהעובדים לאשר העברות כספיות או למסור פרטי גישה למערכות ארגוניות. רמת האמינות של טכנולוגיות אלו מקשה מאוד על זיהוי הזיוף בעין בלתי מזוינת.

עוד תחום שמקבל דחיפה משמעותית עם התפתחות איומי בינה מלאכותית הוא מתקפות פישינג באמצעות צ'אטבוטים חכמים. בעבר, מתקפות פישינג היו מתבססות על קישורים זדוניים והודעות דוא"ל גנריות, אך כיום תוקפים יכולים להפעיל בוטים אינטראקטיביים בעלי יכולות מתקדמות לניהול שיחות משכנעות בזמן אמת. משתמש עשוי להאמין כי הוא משוחח עם גורם רשמי של בנק, ספק שירות או תמיכה טכנית, ולעיתים קרובות אף למסור סיסמאות ונתונים רגישים מבלי לחשוד בכך.

כדי להתמודד עם איומים אלו, ארגונים מחויבים לאמץ גישות חדשניות להגנה מפני התקפות הנדסה חברתית. השימוש בטכנולוגיות כגון אימות רב-שלבי (MFA), זיהוי חריגות מבוסס AI והדרכות מודעות תקופתיות יכול להפחית משמעותית את הסיכוי להצלחה של מתקפות התחזות מתוחכמות. כמו כן, על מומחי אבטחת סייבר לפתח כלים מהירים לזיהוי זיופים דיגיטליים וכך להגביל את יכולת הנזק של תוקפים בתחום זה.

מניפולציה של נתונים והתקפות על מודלים של למידת מכונה

עם עליית השימוש בלמידת מכונה בתחומי אבטחת מידע, הולכת וגוברת גם התופעה של מתקפות המבוססות על מניפולציה של נתונים. התקפות אלו ממנפות טכניקות מתקדמות כדי להשפיע על האופן שבו מערכות AI מעבדות מידע ומקבלות החלטות, ובמקרים מסוימים אף מנצלות את מבנה המודלים עצמם כדי לגרום לשיבושים חמורים. אחד מהאיומים המרכזיים בתחום זה הוא מתקפות מסוג "הרעלת נתונים" (Data Poisoning), שבהן תוקפים משנים את מערכי הנתונים שעליהם מתאמנים האלגוריתמים, כך שהתוצאות הופכות לבלתי אמינות או אף מוטעות לחלוטין.

בהתקפה מסוג זה, הנתונים המזויפים מוכנסים בהדרגה למאגר המידע של המערכת, מה שמוביל לכך שלמידת המכונה מאמצת דפוסים שגויים. לדוגמה, תוקפים יכולים לשנות מסד נתונים פיננסי כדי לגרום למערכות לנבא מגמות שוק בצורה שגויה, מה שעלול לשבש פעילות של מוסדות פיננסיים. באופן דומה, שינוי מכוון במערכות אבטחה יכול לגרום לזיהוי שגוי של איומים, ובכך לאפשר פריצה לרשתות ארגוניות ללא התנגדות משמעותית.

מתקפה נוספת שמשפיעה על מודלים של למידת מכונה היא מתקפת "עיוות מדגם" (Adversarial Attack), שבה התוקפים מכניסים שינויים כמעט בלתי נראים בנתונים נכנסים, כך שמודל הבינה המלאכותית מסיק מסקנות שגויות. דוגמה לכך ניתן לראות בתחום זיהוי התמונה, שבו ניתן לשנות פיקסלים מסוימים בתמונה כך שהמערכת תתייג אותם בצורה שגויה – למשל, שלט עצור יכול להיות מזוהה כמספר בית, מה שמטיל סיכון חמור על מערכות רכב אוטונומיות.

בנוסף, איומי בינה מלאכותית משתלבים גם בהתקפות נגד מנגנוני אימות וזיהוי משתמשים. באמצעות מניפולציה מורכבת של נתונים ביומטריים, כמו טביעות אצבע או זיהוי פנים, ניתן לתעתע במערכות אבטחה ולהעניק גישה בלתי מורשית לתוקפים. כך למשל, תוקפים יכולים לפתח אלגוריתמים אשר יוצרים תמונות או הקלטות קוליות מזויפות המסוגלות להערים על מערכות אבטחה מבוססות קול ותמונה.

בעוד שאבטחת סייבר ממשיכה להתפתח כדי לספק הגנה מפני איומים אלו, הפתרון דורש גישה רב-שכבתית הכוללת זיהוי פערים בנתונים, יישום טכניקות נגד כגון robust learning ושילוב מנגנוני בקרה שיכולים לאתר ניסיונות זדוניים בזמן אמת. כמו כן, שילוב אלגוריתמים המסוגלים לזהות דפוסי תקיפה פוטנציאליים במסגרת תהליכי אימון מודלים יכול להקטין את היכולת של תוקפים לשבש את פעילותם.

אוטומציה של התקפות סייבר ושיפור יכולות התוקפים

התקדמות טכנולוגיית בינה מלאכותית הובילה לאוטומציה חסרת תקדים של התקפות סייבר, מה שמשפר את יכולתם של תוקפים לבצע מתקפות בקנה מידה רחב עם מאמץ מינימלי. בעבר, התקפות דרשו אינטראקציה ידנית מתמשכת, אך כיום מערכות AI מתוחכמות מאפשרות לבצע פעולות רבות בצורה אוטונומית לחלוטין, מה שמגביר את היקף האיומים ומקטין את הסיכוי לזיהוים ולסיכול מוקדם.

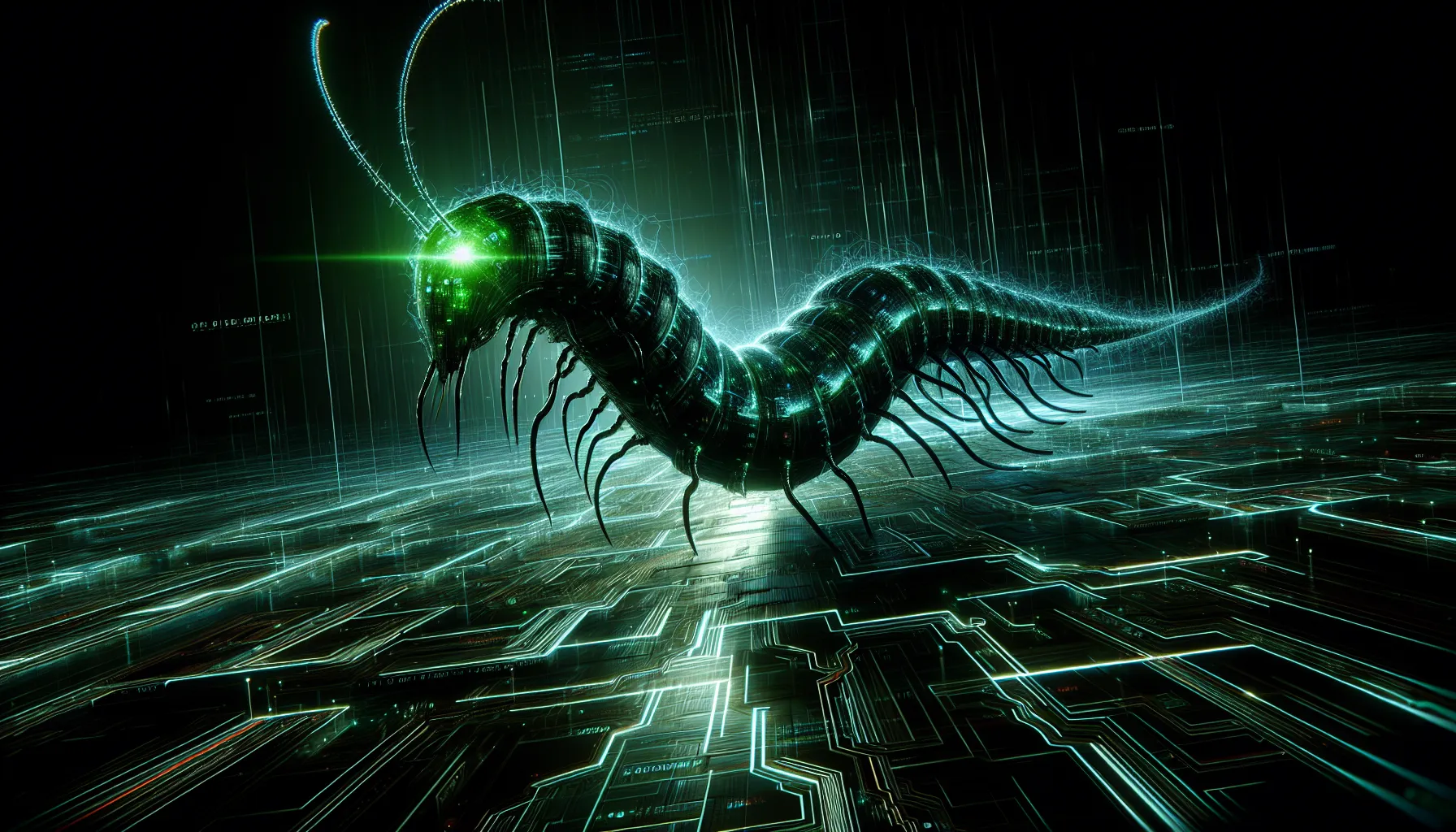

אחת הדרכים שבהן אנו עדים לשיפור משמעותי ביכולת התוקפים היא פיתוח תולעים ונוזקות חכמות אשר מסתגלות בזמן אמת להתגוננות המערכת המותקפת. למשל, קוד זדוני מבוסס למידת מכונה מסוגל להעריך אילו מנגנוני אבטחת סייבר פועלים במערכת, להתאים את צורת פעולתו ולחמוק מזיהוי. נוזקות מתקדמות יכולות לשנות כתובות IP, לבצע התחזויות חכמות ולהתפשט ברחבי רשתות פריצה באופן עצמאי.

יתרון נוסף שהתוקפים מנצלים הוא יצירת בוטים חכמים הפועלים באופן אוטומטי כדי לבצע מתקפות מתמשכות על מערכות שונות. למשל, בביצוע מתקפות פישינג, ניתן להשתמש בבוטים המונעים על ידי AI כדי ליצור הודעות מותאמות אישית לקורבנות ולשלוח אותן בקנה מידה רחב. בוטים אלו מנתחים את התגובות של המשתמשים, משפרים את הטקסטים שנשלחים ומעלים את סיכויי ההצלחה של המתקפה.

אנחנו גם עדים לשיפורים משמעותיים באופן שבו התקפות brute force מתבצעות, למשל בפריצה לרשתות ארגוניות או בפיצוח סיסמאות. בעזרת בינה מלאכותית, תוקפים יכולים לנתח דפוסי יצירת סיסמאות, להשתמש בלוגיקה מבוססת AI כדי לנחש סיסמאות מורכבות תוך זמן קצר בהרבה בהשוואה לשיטות מסורתיות ולהתגבר על הגנות כמו נעילה לאחר ניסיונות כושלים רבים.

בנוסף, קמפיינים של מתקפות DDoS הפכו לאוטומטיים ומתוחכמים במיוחד. אם בעבר המתקפות הללו הסתמכו על שליחת כמויות עצומות של בקשות ממספר רב של מחשבים נגועים, הרי שכיום כבר נעשה שימוש ברשתות בוטים חכמות המבוססות על למידת מכונה. רשתות אלו מסוגלות לזהות חסימות הגנתיות בזמן אמת, להסיט את התעבורה באופן דינמי ולשמר את יעילות ההתקפה לאורך זמן רב יותר.

ההתפתחות של איומי בינה מלאכותית בתחום האוטומציה של מתקפות סייבר דורשת התאמות דחופות במערכות ההגנה הקיימות. ארגונים חייבים לשלב מערכות לזיהוי התנהגות חריגה, ללמוד לעקוב אחר פעילות בוטים בצורה חכמה ולפתח אסטרטגיות אבטחה שמבוססות אף הן על AI כדי להקדים את התוקפים. ישנה חשיבות הולכת וגוברת להסתמך על פתרונות בזמן אמת המבוססים על ניתוח דפוסים ולחזק את ההגנות באמצעות טכנולוגיות מתקדמות של למידת מכונה לזיהוי תקיפות אוטומטיות מוקדם ככל האפשר.

טכניקות הגנה חדשות כנגד איומים מבוססי בינה מלאכותית

ככל שהאיומים בתחום אבטחת סייבר מתפתחים ומבוססים יותר על טכניקות מתקדמות של בינה מלאכותית, כך עולה הצורך בפיתוח גישות הגנה חדשות ומתקדמות. כדי להתמודד עם סוגי התקיפות המורכבות הללו, יש לאמץ שילוב של טכניקות מסורתיות יחד עם פתרונות מבוססי AI שמסוגלים לזהות ולהגיב לאיומים דינמיים במהירות וביעילות.

אחת השיטות היעילות להגנה מפני איומי בינה מלאכותית היא שימוש בלמידת מכונה הפוכה – מודלים מתקדמים של AI המשתמשים בניתוח התנהגותי כדי לזהות דפוסים המאפיינים פעילויות זדוניות. מערכות אלו יכולות לעקוב אחר זרמי נתונים בזמן אמת, לזהות חריגות במבנה או בשגרת ההתנהגות של משתמשים ולהתריע על איומים פוטנציאליים עוד בשלב מוקדם. לדוגמה, אם מערכת מזהה ניסיון פריצה שבו קוד זדוני משנה את עצמו בהתבסס על תגובות ההגנה של המערכת, ה-AI יוכל לזהות את השינויים החוזרים ולהגיב בהתאם.

גישה נוספת היא שימוש בטכנולוגיות המבוססות על מודלים של למידת חיזוק (Reinforcement Learning) לצורך הגנה מיטבית מפני מתקפות חכמות. אלגוריתמים מסוג זה יכולים להתאים עצמם בצורה דינמית לאיומים חדשים, ללמוד מהם ולשכלל את יכולות ההגנה בהתבסס על תרחישים משתנים. כך ניתן להתמודד גם עם איומים שטרם זוהו בעבר, שכן המערכת מסוגלת לגלות גם דפוסי תקיפה בלתי מוכרים.

מעבר לכך, ארגונים מאמצים כיום יותר ויותר את השימוש במערכות אימות מבוססות AI כמו ניתוח ביומטרי מתקדם, מערכות לזיהוי קול וזיהוי פנים המבוססות על נתוני עומק. שימוש בטכנולוגיות אלו מסייע בצמצום הסיכוי להונאות ולמתקפות התחזות (deepfake), שהופכות לנפוצות יותר. מערכות אלו מסוגלות לגלות זיופים דיגיטליים מתוחכמים ולמנוע מהאקרים גישה לא מורשית למידע רגיש.

אחד התחומים הבולטים כיום בהגנה מפני איומים הוא השימוש ב-AI לניהול תגובה לאיומים באופן אוטומטי. פלטפורמות אבטחה מתקדמות מסוגלות לנתח התראות ולהבין אילו מתקפות אכן מהוות סיכון ממשי, ובכך להפחית התראות שווא ולמקד את המשאבים באיומים הקריטיים יותר. מערכות מסוימות אף מסוגלות לבצע פעולות מנע ללא התערבות אדם, כמו חסימת כתובות IP חשודות, עדכון כללים חוסמים ומתן מענה לאיומים חדשים באופן מיידי.

לצד זאת, פתרונות מבוססי רשתות עצביות מתפתחות (Neural Networks) מאפשרים זיהוי מתוחכם של דפוסי תקיפה נסתרות, שאינן ניתנות לאיתור על ידי שיטות מסורתיות. מערכות אלו, כאשר הן משולבות עם בינה מלאכותית, מסוגלות לספק הגנה חזקה במיוחד כנגד התקפות אשר מתאמות את עצמן לסביבות שונות, דוגמת התקפות המנצלות חולשות של מודלים של למידת מכונה.

לסיכום, ככל שהאיומים בתחום בינה מלאכותית ממשיכים להתפתח, כך עולה הצורך בגישות הגנה חכמות ומתקדמות. שילוב של למידת מכונה, זיהוי אנומליות מבוסס AI ותגובה אוטומטית לאיומים הוא המפתח ליצירת סביבה בטוחה יותר מפני איומים מודרניים בתחום אבטחת סייבר.

תפקיד הרגולציה והאתיקה בהתמודדות עם סיכוני בינה מלאכותית

כדי להגן על האינטרס הציבורי ולמנוע שימוש זדוני בטכנולוגיות מבוססות בינה מלאכותית, נדרשים תקנים ורגולציות מחמירות יותר בתחום אבטחת סייבר. התקדמות המהירה של טכנולוגיות AI מציבה אתגר למערכות החקיקה הקיימות, שכן רבות מהמתקפות המתוחכמות נשענות על חדשנות טכנולוגית שלא הייתה צפויה בעת כתיבת החוק. לכן, מדינות וארגונים בינלאומיים פועלים לפיתוח מסגרות רגולטוריות שימנעו ניצול פוטנציאלי לרעה של למידת מכונה ואלגוריתמים חכמים.

אחד מהכיוונים המרכזיים של הרגולציה בתחום זה מתמקד בדרישה לשקיפות וליכולת לבדוק את תהליכי קבלת ההחלטות של אלגוריתמים. כאשר מודלים מסוימים מבוססי AI מסוגלים לבצע תקיפות מתוחכמות, חשוב לבדוק כיצד ניתן לחשוף ולנטר את פעילותם, במיוחד אם מדובר בטכנולוגיות הנמצאות בשימוש גורמים קריטיים כמו מוסדות פיננסיים, מערכות בריאות ותשתיות לאומיות. התקנת חוקים אשר מחייבים תהליכי ביקורת ופיקוח על מודלים אלה יכולה להגביל את יכולתם לשמש למטרות פריצה וניצול לרעה.

נוסף על כך, הרגולציה צריכה לאכוף עמידה בסטנדרטים מחמירים של אבטחה ופיקוח על חברות המפתחות מוצרים מבוססי AI. חברות אלה נדרשות להבטיח כי הפלטפורמות שלהן לא יוכלו להיות מנוצלות לצורך יצירת מתקפות אבטחת סייבר. יש חשיבות גם לדרישות אבטחת מידע קפדניות יותר למערכות המתבססות על למידת מכונה, כך שמודלים לא יוכלו לעבור "הרעלה" או מניפולציה על ידי שחקנים זדוניים.

ברמה הגלובלית, גם התקנות הבינלאומיות עוסקות בצורך לפתח סטנדרטים אחידים להתמודדות עם איומים מבוססי AI. מוסדות כמו האיחוד האירופי וארגונים כמו ה-IEEE פועלים להגדרת עקרונות אתיים מחייבים לפיתוח ושימוש בטכנולוגיות מתקדמות. כללים כגון עקרונות פיקוח על קוד פתוח בתחום למידת מכונה ודרישות מחמירות יותר לפרסום מחקרים העוסקים בטכניקות התקפה מתקדמות, יכולים לסייע בצמצום פוטנציאל הנזק שבינה מלאכותית עלולה לגרום.

היבט חשוב נוסף הוא האתיקה של השימוש בבינה מלאכותית בתחום הסייבר. קיים חשש מוצדק כי ארגונים עלולים להשתמש בטכנולוגיות AI לצורך פעילויות שלא עולות בקנה אחד עם עקרונות של פרטיות ופרוטקשן משפטי. לדוגמה, שימוש במודלים מתקדמים כדי לעקוב אחר עובדים, לבצע פרופילינג אוטומטי של משתמשים או לנתח מידע פרטי ללא ידיעת בעלי הנתונים. כדי למנוע זאת, חוקים המתמקדים בהגנת פרטיות ובהתמודדות עם דילמות אתיות של AI צריכים להיות חלק בלתי נפרד מתכנון עתידי של רגולציה בתחום.

ככל שהרגולטורים מאחרים לפעול, כך התוקפים ממשיכים לנצל את החוסר בחוקים ברורים ונותנים לעצמם יתרון משמעותי. לכן, שילוב מאמצים בין קובעי מדיניות, חברות טכנולוגיה וארגוני אבטחת סייבר הוא קריטי להבטחת סביבה דיגיטלית בטוחה יותר. פיתוח רגולציה חכמה ומאוזנת יסייע בצמצום איומי בינה מלאכותית ויבטיח שהחדשנות תישאר כלי לשיפור החיים, ולא מנוע לפריצות והתקפות על מערכות קריטיות.

עתיד אבטחת הסייבר בעולם של איומים חכמים

עם ההתקדמות המואצת של טכנולוגיות בינה מלאכותית, גם תחום אבטחת סייבר צפוי להשתנות באופן מהותי בשנים הקרובות. בעוד שתוקפים ממשיכים לנצל את היכולות המתפתחות של למידת מכונה ואלגוריתמים מתקדמים כדי לבצע תקיפות מתוחכמות, צוותי אבטחה וארגונים מפתחים פתרונות חדשניים כדי להגן על מערכותיהם מפני איומי בינה מלאכותית.

אחת המגמות העתידיות המרכזיות היא הפיתוח של טכנולוגיות מתקדמות לזיהוי וחיזוי איומים בזמן אמת. מערכות אבטחה מבוססות AI ישתמשו בלמידת מכונה כדי לעבד כמויות עצומות של נתונים ולזהות דפוסים חריגים לפני שהאיום יתממש. באמצעות חיזוי מבוסס נתונים, ניתן יהיה לסכל מתקפות עוד לפני שהן מתרחשות, מה שיעניק יתרון משמעותי למגני הסייבר.

בנוסף, בעתיד נראה שימוש הולך וגובר בפתרונות של אבטחת סייבר מבוססי אוטומציה. כלי אבטחה יוכלו להגיב באופן מיידי למתקפות, ללא צורך בהתערבות אנושית ישירה. כך למשל, ארגונים יוכלו ליישם מנגנונים המנתחים את דפוסי העבודה של משתמשים, וכאשר נמצא שינוי מחשיד בהתנהגות, למערכת תהיה אפשרות לחסום גישה חשודה באופן אוטומטי ולמנוע פריצה למערכות קריטיות.

תחום נוסף שצפוי להתפתח משמעותית הוא שילוב של טכניקות אבטחה מרובות שכבות, כולל שילוב בין אלגוריתמים ביו-ביומטריים, הצפנה חכמה ושימוש בבינה מלאכותית משלימה לניטור התנהגותי. פתרונות אלו יפחיתו את האפשרות של תוקפים להשתמש במתקפות הנדסה חברתית מתוחכמות, במיוחד לאור הגידול בשימוש בטכניקות כמו deepfake לצורכי התחזות וגישה בלתי מורשית למידע רגיש.

לצד זאת, עולות גם סוגיות של אתיקה ורגולציה אשר יעצבו את עתיד המאבק באיומי בינה מלאכותית. גופים רגולטוריים ברחבי העולם יידרשו לפתח סטנדרטים חדשים ולוודא כי חברות טכנולוגיה מאמצות מודלים של שקיפות ושליטה נאותה בטכנולוגיות AI. כמו כן, ההיערכות העתידית תכלול גם חיזוק שיתוף הפעולה בין מדינות, חברות פרטיות וארגונים ממשלתיים במטרה להגן על המרחב הדיגיטלי הגלובלי ולהבטיח שמערכות קריטיות יישארו מוגנות.

בעוד שהאתגרים הולכים וגדלים עם הופעתם של איומים חדשים, גם החדשנות בתחום אבטחת סייבר והיכולות ההגנתיות צפויות להתקדם. עם ההשקעה המתמשכת בפיתוח כלים חכמים המבוססים על AI, לצד אימוץ אסטרטגיות מתוחכמות לניהול סיכונים, ניתן יהיה לצמצם את הסיכונים שמציבים איומי בינה מלאכותית וליצור סביבה בטוחה יותר לעידן הדיגיטלי.

Comments (77)

פוסט מרתק ומעמיק שמציג בצורה ברורה את האתגרים החדשים שהבינה המלאכותית מביאה לעולם אבטחת המידע. חשוב מאוד להעלות את המודעות ולהבין שהטכנולוגיה משדרגת לא רק את הכלים שלנו, אלא גם את האיומים שאנו עומדים מולם. תודה על השיתוף!

פוסט מעורר מחשבה ומאיר נקודה קריטית בעולם אבטחת המידע כיום. השילוב בין בינה מלאכותית לאיומי סייבר מציב אתגרים חדשים שמצריכים מאיתנו להיערך בצורה חכמה וחדשנית. חשוב שנמשיך לפתח כלים מתקדמים ולהעלות את המודעות כדי להישאר צעד אחד לפני התוקפים. תודה על השיתוף והתובנות המעמיקות!

המאמר מעלה נקודה מאוד חשובה ומדויקת לגבי האתגרים החדשים שמביאה איתה הבינה המלאכותית בתחום אבטחת המידע. השימוש בטכנולוגיות מתקדמות מצד התוקפים מחייב אותנו להיות תמיד צעד אחד לפני, ולהשקיע בפיתוח פתרונות אבטחה חדשניים שיוכלו להתמודד עם איומים מתוחכמים כמו זיופים קוליים ומתקפות פישינג ממוקדות. תודה על התובנות המעמיקות!

פוסט מרתק ומעמיק! חשוב מאוד שנבין את השינויים המהירים בתחום האיומים הסייבריים שמונעים על ידי בינה מלאכותית, כדי שנוכל להתכונן ולהגיב בצורה חכמה ומתקדמת. תודה על התובנות החשובות!

תודה על התובנות החשובות! אכן, השילוב של בינה מלאכותית באיומי הסייבר מציב אתגרים חדשים ומורכבים, ומדגיש את הצורך בפיתוח טכנולוגיות הגנה חדשניות ומתוחכמות יותר. חשוב שנמשיך להעמיק את ההבנה שלנו בתחום ולהיות ערניים לשינויים המתמידים בסביבת האבטחה.

פוסט מעולה ומעורר מחשבה! חשוב מאוד שנבין את האתגרים החדשים ש-Bינה מלאכותית מביאה לעולם אבטחת המידע, ונפעל בצורה מתקדמת ויצירתית כדי להגן על מערכותינו. רק באמצעות חדשנות ושיתוף פעולה נוכל להתמודד עם האיומים המתפתחים ולהבטיח סביבה דיגיטלית בטוחה יותר.

פוסט מעורר מחשבה ומאוד רלוונטי לעידן הטכנולוגי שבו אנו חיים. חשוב שנבין את האתגרים החדשים שמביאה הבינה המלאכותית ונפעל לפיתוח פתרונות אבטחה חדשניים שיגנו עלינו בצורה מיטבית. תודה על השיתוף!

פוסט מצוין ומעמיק! אין ספק שהשילוב בין בינה מלאכותית לאיומי הסייבר משנה לחלוטין את כללי המשחק, ומחייב אותנו לחשוב מחדש על דרכי ההגנה שלנו. חשוב להמשיך להשקיע במחקר ופיתוח טכנולוגיות מתקדמות כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות החשובות!

מאמר מעורר מחשבה ומעמיק מאוד! השילוב בין בינה מלאכותית לאיומי סייבר בהחלט משנה את כללי המשחק, ומדגיש את הצורך בגישה חדשנית ומותאמת לאבטחת מידע. חשוב שנמשיך להשקיע בטכנולוגיות הגנה מתקדמות ובמודעות ארגונית כדי להתמודד עם האתגרים המתפתחים. תודה על התובנות החשובות!

פוסט מצוין ומעמיק! באמת, השילוב בין בינה מלאכותית לאיומי סייבר משנה את כללי המשחק ויוצר אתגר חדש ומורכב לאבטחת מידע. חשוב שנמשיך להתעדכן ולהשקיע בטכנולוגיות מתקדמות כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות החשובות!

תודה על הפוסט המעמיק! באמת, ההתפתחות המהירה של הבינה המלאכותית משנה את כללי המשחק בתחום אבטחת הסייבר, ומדגישה את הצורך בהיערכות מתקדמת וחדשנית. חשוב שנשקיע בפיתוח טכנולוגיות הגנה חכמות ונלמד לזהות את האיומים המתוחכמים בזמן אמת. המשך כך!

פוסט מרתק ומעמיק שמאיר נקודה חשובה ומשמעותית בעולם אבטחת המידע. השילוב בין בינה מלאכותית לאיומי סייבר מחייב חשיבה מחודשת וחדשנית לגבי דרכי ההגנה שלנו. תודה על התובנות החשובות!

תודה על הפוסט המעמיק! באמת, השילוב בין בינה מלאכותית לאיומי סייבר משנה לחלוטין את כללי המשחק ומחייב אותנו לחשוב מחדש על דרכי ההגנה. חשוב שנשקיע בפיתוח טכנולוגיות מתקדמות ונקדם מודעות בארגונים כדי להישאר צעד אחד לפני התוקפים. רעיון מצוין שמעלה נקודות חשובות לדיון!

תודה על הפוסט המעמיק והחשוב! אכן, השילוב בין בינה מלאכותית לאיומי הסייבר משנה לחלוטין את כללי המשחק ודורש מאיתנו לחשוב מחדש על דרכי ההגנה. רק באמצעות חדשנות מתמדת ושיתוף פעולה בין מומחים נוכל להתמודד עם האתגרים המורכבים הללו בצורה אפקטיבית. רעיון מעורר השראה שמדגיש את הצורך להיות תמיד צעד אחד לפני התוקפים.

פוסט מעולה שמאיר נקודה קריטית ומאתגרת בעולם אבטחת המידע כיום. השילוב בין בינה מלאכותית לאיומי סייבר מחייב אותנו לחשוב מחדש על דרכי ההגנה ולהשקיע בטכנולוגיות חדשניות שיכולות להתמודד עם האיומים המתפתחים במהירות. תודה על התובנות החשובות!

מאמר מרתק שמאיר את האתגרים החדשים שמביאה הבינה המלאכותית לעולם אבטחת המידע. חשוב מאוד שנבין את ההשפעות של הטכנולוגיות המתקדמות הללו ונשקיע בפיתוח פתרונות חדשניים שיתאימו למתקפות המתוחכמות. תודה על ההארה החשובה!

פוסט מעולה שמאיר נקודה קריטית בעולם אבטחת המידע של היום! השילוב בין בינה מלאכותית לאיומי סייבר מציב אתגר חדש ומורכב, והמודעות לכך היא הצעד הראשון לקראת פיתוח פתרונות חדשניים ומותאמים. חשוב להמשיך להשקיע במחקר ובפיתוח טכנולוגיות הגנה מתקדמות כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות החשובות!

פוסט מצוין ומעמיק שמאיר על האתגרים החדשים בתחום אבטחת הסייבר בעידן הבינה המלאכותית. חשוב מאוד שנבין שהטכנולוגיה מתקדמת במהירות, ולכן גם דרכי ההגנה חייבות להתעדכן ולהיות פרואקטיביות יותר. תודה על התובנות המעניינות!

תודה על הפוסט המעמיק! באמת, ההתפתחות המהירה של הבינה המלאכותית משנה את כללי המשחק בתחום אבטחת המידע, ודורשת מאיתנו להיות ערניים ולפתח פתרונות חדשניים שיתמודדו עם האיומים המתוחכמים האלה. חשוב להמשיך ללמוד ולהתעדכן כדי להישאר צעד אחד לפני התוקפים.

פוסט מרתק ומעמיק שמאיר על האתגרים החדשים בתחום אבטחת המידע בעידן הבינה המלאכותית. חשוב מאוד שנבין את ההשלכות של הטכנולוגיה המתפתחת ונפעל לפתח פתרונות חדשניים שיתמודדו עם האיומים המתוחכמים האלה בצורה יעילה ומקיפה. תודה על ההארה החשובה!

פוסט מצוין ומעמיק! באמת מרתק לראות כיצד הבינה המלאכותית משנה את כללי המשחק בתחום אבטחת המידע. חשוב שנמשיך להתעדכן ולהשקיע בפיתוח טכנולוגיות הגנה חדשניות כדי להתמודד עם האיומים המתפתחים בצורה חכמה ויעילה. תודה על השיתוף!

תודה על הפוסט המעמיק! אין ספק שהשילוב בין בינה מלאכותית לאיומי סייבר משנה לחלוטין את כללי המשחק. חשוב מאוד שנמשיך לפתח טכנולוגיות הגנה חדשניות ולשפר את המודעות בקרב ארגונים כדי להישאר צעד אחד לפני התוקפים. נושא קריטי ומרתק!

פוסט מעולה שמאיר נקודה קריטית בעידן הדיגיטלי שלנו. הבינה המלאכותית אכן משנה את חוקי המשחק בתחום אבטחת המידע, ומחייבת אותנו לחשוב מחדש על האסטרטגיות שלנו ולהשקיע בטכנולוגיות מתקדמות כדי להישאר צעד אחד לפני האיומים המתפתחים. תודה על התובנות החשובות!

פוסט מעולה ומעמיק! בהחלט חשוב להכיר את האתגרים שהבינה המלאכותית מביאה לעולם אבטחת המידע ולהתעדכן בטכנולוגיות המתקדמות ביותר כדי להגן על מערכותינו בצורה חכמה ויעילה. כלים חדשניים ושיתופי פעולה בין מומחים יהוו מפתח להתמודדות מוצלחת עם האיומים המשתנים.

פוסט מעולה ומעמיק! השילוב בין בינה מלאכותית לאיומי הסייבר באמת משנה את כללי המשחק, וחשוב שנבין את האתגרים החדשים כדי להישאר צעד אחד קדימה. תודה על התובנות החשובות!

מאמר מרתק ומעמיק שמאיר את האתגרים החדשים בעולם אבטחת המידע בעידן הבינה המלאכותית. חשוב מאוד שנמשיך להתעדכן ולהשקיע בטכנולוגיות הגנה מתקדמות כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות החשובות!

תודה על הפוסט המעמיק! נושא הבינה המלאכותית באבטחת מידע הוא קריטי במיוחד בעידן שלנו, וההבנה של האיומים המתפתחים היא הצעד הראשון להגנה יעילה. חשוב שנמשיך להשקיע בטכנולוגיות מתקדמות ובמודעות אנושית כדי להישאר צעד אחד לפני התוקפים. הפוסט מזכיר לנו עד כמה חשוב להיות ערניים וגמישים מול האתגרים החדשים.

תודה על הפוסט המעמיק! זה מדגיש בצורה מצוינת עד כמה הבינה המלאכותית משנה את כללי המשחק בתחום אבטחת המידע. חשוב מאוד שנקדם חשיבה חדשנית ופתרונות מתקדמים כדי להישאר צעד אחד לפני התוקפים. המשך כך!

פוסט מעולה שמאיר נקודה קריטית בעולם אבטחת המידע של היום! השילוב בין בינה מלאכותית לאיומי סייבר באמת משנה את כללי המשחק ודורש מאיתנו להיות ערניים וחדשניים יותר. חשוב שנמשיך להשקיע בטכנולוגיות הגנה מתקדמות ובקידום מודעות בקרב הארגונים והמשתמשים. תודה על התובנות החשובות!

תודה על הפוסט המעמיק! באמת, ההתפתחות המהירה של הבינה המלאכותית יוצרת אתגרים חדשים ומורכבים בתחום אבטחת הסייבר. חשוב שנשקיע בפיתוח טכנולוגיות הגנה מתקדמות ונקדם מודעות בקרב ארגונים כדי להישאר צעד אחד לפני התוקפים. כלים חכמים ושיתוף ידע הם המפתח להתמודדות מוצלחת עם האיומים המשתנים.

תודה על הפוסט המעמיק! באמת, השילוב בין בינה מלאכותית לאיומי סייבר משנה את כל חוקי המשחק ומחייב אותנו לחשוב מחדש על דרכי ההגנה שלנו. חשוב שנשקיע בפיתוח כלים חכמים ומותאמים שיתמודדו עם האתגרים החדשים בצורה יעילה ומדויקת. המשך כך!

פוסט מאוד מעניין ומעמיק! אכן, השילוב בין בינה מלאכותית לאיומי סייבר משנה לחלוטין את כללי המשחק ומחייב אותנו לחשוב מחדש על דרכי ההגנה. חשוב שנשקיע בפיתוח טכנולוגיות מתקדמות ונשמור על ערנות גבוהה כדי להקדים את התוקפים. תודה על התובנות החשובות!

פוסט מעורר מחשבה וחשוב מאוד! השילוב של בינה מלאכותית באיומי הסייבר מציב אתגרים חדשים ומורכבים, ולכן חשוב שנמשיך להשקיע במחקר ופיתוח פתרונות אבטחה חכמים ועדכניים. תודה על ההארה וההסבר המקיף!

פוסט מאוד מעורר מחשבה ומאיר נקודות חשובות על האתגרים החדשים בתחום אבטחת המידע. השילוב של בינה מלאכותית באיומי הסייבר בהחלט משנה את חוקי המשחק ודורש מאיתנו להיות תמיד צעד אחד קדימה עם פתרונות חדשניים ומותאמים. תודה על השיתוף!

פוסט מרתק ומעמיק שמאיר נקודה חשובה מאוד בעידן הדיגיטלי שלנו. השילוב בין בינה מלאכותית לאיומי סייבר מייצר אתגר חדש ומורכב, שדורש חשיבה יצירתית וחדשנית בתחום האבטחה. תודה על ההארה וההזמנה לחשיבה על פתרונות מתקדמים!

פוסט מצוין ומעמיק שמאיר באור חדש את האתגרים המורכבים שנובעים משילוב הבינה המלאכותית באבטחת מידע. חשוב מאוד שנקדם פתרונות חדשניים ונלמד להתאים את מערכות ההגנה שלנו למציאות המשתנה, כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות החשובות!

פוסט מעולה שמאיר נקודה קריטית ומאתגרת בעידן הטכנולוגי שלנו. השילוב בין בינה מלאכותית לאיומי סייבר מחייב אותנו להיות ערניים ולפתח כלים חדשניים שיכולים לעמוד בקצב השינויים המהיר. תודה על התובנות החשובות!

תודה על הפוסט המעמיק! באמת מרתק לראות כיצד הבינה המלאכותית משנה את כללי המשחק בתחום אבטחת המידע. חשוב שנמשיך להתעדכן ולהשקיע בטכנולוגיות הגנה מתקדמות כדי להישאר צעד אחד לפני התוקפים. הפוטנציאל והאתגרים שנלווים לכך מחייבים חשיבה יצירתית ושיתופי פעולה חזקים בין כל הגורמים המעורבים.

פוסט מעורר מחשבה ומאוד רלוונטי לעידן הדיגיטלי שבו אנו חיים. חשוב מאוד להכיר את האתגרים החדשים שהבינה המלאכותית מביאה איתה לאבטחת המידע, ולהשקיע בפיתוח כלים וטכנולוגיות מתקדמות שיכולים להתמודד עם האיומים המתפתחים במהירות. תודה על ההארה החשובה!

תודה על הפוסט המעמיק! אכן, השילוב בין בינה מלאכותית לאיומי הסייבר משנה לחלוטין את חוקי המשחק, ומחייב אותנו לחשוב מחדש על אסטרטגיות ההגנה שלנו. חשוב להשקיע בטכנולוגיות מתקדמות ובמודעות ארגונית כדי להישאר צעד אחד לפני התוקפים. מאמר מעורר מחשבה ומעודד לפעולה!

תוכן מעולה ומאוד רלוונטי! אין ספק שהשילוב בין בינה מלאכותית לאיומי סייבר משנה את כללי המשחק וגורם לנו לחשוב מחדש על דרכי ההגנה שלנו. חשוב שנמשיך להתעדכן ולהשקיע בטכנולוגיות מתקדמות כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות החשובות!

תודה על התובנות החשובות! באמת, השילוב בין בינה מלאכותית לאיומי סייבר משנה את כללי המשחק ודורש מאיתנו להיות תמיד צעד אחד קדימה. חשוב להשקיע בטכנולוגיות מתקדמות ולפתח מודעות ארגונית גבוהה כדי להתמודד עם האתגרים החדשים בצורה יעילה ובטוחה.

תודה על הפוסט המעמיק! זה מרתק לראות כיצד הבינה המלאכותית משנה את כללי המשחק בתחום אבטחת המידע, ומדגיש את הצורך בגישה חדשנית ומותאמת להתמודדות עם האיומים המתפתחים. חשוב שנמשיך להשקיע בטכנולוגיות מתקדמות ובמודעות כדי להישאר צעד אחד לפני התוקפים.

פוסט מעולה שמאיר נקודה חשובה ומשמעותית בעולם אבטחת המידע! אין ספק שהשילוב בין בינה מלאכותית לאיומי סייבר משנה את כללי המשחק ודורש מאיתנו להיות תמיד צעד אחד קדימה. תודה על התובנות המעמיקות והקריאה לפיתוח פתרונות חדשניים שיתמודדו עם האתגרים המתפתחים.

פוסט מאוד חשוב ומעורר מחשבה! השילוב בין בינה מלאכותית לאיומי סייבר באמת משנה את כללי המשחק ופותח אתגר חדש בפני עולם אבטחת המידע. חייבים להמשיך לפתח פתרונות חדשניים ולהיות תמיד צעד אחד לפני התוקפים. תודה על התובנות המעמיקות!

מאמר מרתק ומעמיק שמאיר על האתגרים החדשים שהבינה המלאכותית מביאה לעולם אבטחת המידע. חשוב שנמשיך להתעדכן ולהשקיע בטכנולוגיות מתקדמות כדי להגן על מערכותינו בצורה חכמה ומותאמת למציאות המשתנה. תודה על השיתוף!

תוכן מרתק ומעמיק שמאיר נקודה חשובה ביותר בעידן הדיגיטלי שלנו. ההבנה שהבינה המלאכותית יכולה לשמש גם ככלי מתקדם להתקפות סייבר מדגישה את הצורך הדחוף בפיתוח פתרונות אבטחה חדשניים ועדכניים. תודה על ההארה והקריאה לפעולה!

תודה על הפוסט המעמיק! באמת, השילוב בין בינה מלאכותית לאיומי סייבר משנה את כללי המשחק ומחייב אותנו לחשוב מחדש על דרכי ההגנה. חשוב להשקיע במחקר ופיתוח פתרונות חדשניים שיתמודדו עם האתגרים המורכבים הללו בצורה חכמה ומותאמת. המשך כך!

פוסט מעולה שמאיר נקודה קריטית וחשובה בעידן הדיגיטלי שלנו! השילוב בין בינה מלאכותית לאיומי סייבר אכן משנה את כללי המשחק ודורש חשיבה מחודשת על דרכי ההגנה. תודה על התובנות המעמיקות וההצעה לחשיבה חדשנית בתחום אבטחת המידע.

פוסט מצוין שמדגיש בצורה ברורה את האתגרים החדשים בתחום אבטחת המידע בעקבות התפתחות הבינה המלאכותית. חשוב מאוד שנמשיך להתעדכן ולהתאים את מערכות ההגנה שלנו לטכנולוגיות המתפתחות, כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות המעמיקות!

תודה על הפוסט המעמיק והחשוב! באמת, השילוב בין בינה מלאכותית לאיומי סייבר משנה לחלוטין את כללי המשחק ומחייב אותנו לחשוב מחדש על דרכי ההגנה. רק באמצעות חדשנות מתמדת ושיתוף פעולה בין מומחים נוכל להישאר צעד אחד לפני התוקפים ולהבטיח סביבה דיגיטלית בטוחה יותר.

תודה על הפוסט המעמיק והעדכני! אכן, השילוב בין בינה מלאכותית לאיומי סייבר מייצר אתגר חדש ומורכב שדורש חשיבה חדשנית ותגובה מהירה. חשוב שנמשיך להשקיע בפיתוח טכנולוגיות הגנה מתקדמות ובמודעות ארגונית כדי להישאר צעד אחד לפני התוקפים. התובנות שהצגת מחזקות את החשיבות של שיתוף ידע ושיתוף פעולה בין גורמים שונים בתחום.

פוסט מעולה ומעמיק שמאיר נקודה קריטית בעידן הדיגיטלי שלנו. אין ספק שהשילוב בין בינה מלאכותית לאיומי סייבר מציב אתגרים חדשים ומורכבים, וחשוב שנשקיע בפיתוח טכנולוגיות הגנה חדשניות ומותאמות. תודה על התובנות החשובות!

תודה על הפוסט המעמיק! חשוב מאוד להבין שהבינה המלאכותית משנה לחלוטין את כללי המשחק בתחום אבטחת המידע, ומציבה אתגרים חדשים שדורשים חשיבה יצירתית וחדשנית. רק באמצעות פיתוח טכנולוגיות הגנה מתקדמות ושיתוף פעולה בין כל הגורמים נוכל להישאר צעד אחד לפני התוקפים. ממש נושא קריטי ומרתק!

פוסט מעולה שמאיר נקודה חשובה ומאתגרת בעולם אבטחת המידע כיום! השילוב בין בינה מלאכותית לאיומי סייבר אכן משנה את כללי המשחק ודורש מאיתנו חשיבה יצירתית וחדשנית כדי להגן על מערכות ונתונים קריטיים. תודה על התובנות המעמיקות!

תודה על הפוסט המעמיק! באמת, ההתפתחות המהירה של הבינה המלאכותית משנה את כללי המשחק בתחום אבטחת המידע, ומחייבת אותנו להיערך בצורה חדשנית ויצירתית. חשוב להמשיך להשקיע במחקר ופיתוח של טכנולוגיות הגנה מתקדמות שיכולות להתמודד עם האתגרים החדשים בצורה יעילה וממוקדת.

תודה על הפוסט המעמיק! באמת, השילוב בין בינה מלאכותית לאיומי סייבר משנה לחלוטין את כללי המשחק, ומחייב אותנו לחשוב מחדש על אסטרטגיות ההגנה שלנו. חשוב להמשיך להשקיע בטכנולוגיות מתקדמות ולפתח מודעות ארגונית גבוהה כדי להתמודד עם האתגרים החדשים בצורה מיטבית.

פוסט מעולה ומעמיק שמאיר נקודה קריטית בעידן הדיגיטלי שלנו. חשוב להבין את האתגרים החדשים שהבינה המלאכותית מביאה איתה ולפתח פתרונות חדשניים שיתמודדו עם האיומים המתפתחים. תודה על השיתוף וההעלאת המודעות לנושא כה רלוונטי!

תודה על הפוסט המעמיק! אכן, השילוב בין בינה מלאכותית לאיומי הסייבר מחייב אותנו לחשוב מחדש על דרכי ההגנה ולהשקיע בטכנולוגיות חדשניות. רק באמצעות הבנה מעמיקה ושיתוף פעולה בין מומחים נוכל להישאר צעד אחד לפני התוקפים. מאמר חשוב ומעורר מחשבה!

תודה על הפוסט המעמיק! אכן, ההתפתחות המהירה של הבינה המלאכותית משנה לחלוטין את תחום אבטחת הסייבר ומציבה אתגרים חדשים ומורכבים. חשוב שנמשיך להשקיע במחקר ופיתוח של טכנולוגיות הגנה חדשניות שיכולות להקדים את התוקפים ולהגן על המידע הקריטי שלנו בצורה יעילה.

תודה על הפוסט המעניין! באמת מדובר באתגר משמעותי ששינוי הטכנולוגיה מביא איתו, והצורך להיערך בצורה חכמה ומתקדמת לאבטחת המידע הוא קריטי. חשוב שנמשיך ללמוד ולהתעדכן כדי להגן על מערכותינו בצורה מיטבית בעולם המשתנה כל כך במהירות.

פוסט מעורר מחשבה ומאוד רלוונטי לעידן הדיגיטלי שבו אנו חיים. השילוב בין בינה מלאכותית לאיומי סייבר מדגיש עד כמה חשוב להמשיך ולהשקיע בטכנולוגיות הגנה חדשניות ולפתח מודעות בקרב ארגונים ואנשים פרטיים. תודה על השיתוף!

תודה על הפוסט המעמיק! אכן, השילוב של בינה מלאכותית באיומי הסייבר משנה לחלוטין את חוקי המשחק ודורש מאיתנו להיות ערניים וחדשניים יותר בהגנה על מערכות המידע שלנו. חשוב להמשיך להשקיע במחקר ופיתוח כלים מתקדמים שיכולים לזהות ולהתגונן מפני התקפות חכמות אלו בזמן אמת.

פוסט מרתק ומעמיק! אין ספק שהשילוב בין בינה מלאכותית לאיומי סייבר משנה את כללי המשחק ומצריך חשיבה מחודשת על אסטרטגיות ההגנה שלנו. חשוב שנמשיך להשקיע בטכנולוגיות חדשניות ובמודעות אנושית כדי להישאר צעד אחד לפני התוקפים. תודה על התובנות החשובות!

מאמר מרתק שמאיר בצורה ברורה את האתגרים החדשים בעולם אבטחת המידע. השילוב בין בינה מלאכותית לאיומי סייבר מראה עד כמה חשוב להמשיך ולהתחדש בטכנולוגיות ההגנה שלנו. תודה על התובנות החשובות!

פוסט מעורר מחשבה ומאוד רלוונטי לעידן הדיגיטלי שבו אנו חיים. חשוב שנבין שהבינה המלאכותית משנה את כללי המשחק בתחום אבטחת המידע, ושהתגובה שלנו חייבת להיות מהירה ומותאמת לטכנולוגיות החדשות. תודה על ההארה החשובה!

תודה רבה על הפוסט המעמיק! אכן, ההתפתחות המהירה של הבינה המלאכותית יוצרת אתגרים חדשים ומורכבים בתחום אבטחת המידע, והצורך בגישה חדשנית ומותאמת למציאות המשתנה הוא קריטי. חשוב שנמשיך להשקיע בטכנולוגיות הגנה מתקדמות ובמודעות מקצועית כדי להישאר צעד אחד לפני האיומים המתוחכמים הללו.

פוסט מעורר מחשבה ומאוד רלוונטי לעידן הטכנולוגי בו אנו חיים. חשוב להכיר את האתגרים החדשים שהבינה המלאכותית מביאה איתה ולפתח פתרונות חדשניים שיגנו עלינו בצורה מיטבית. תודה על השיתוף וההארה!

פוסט מרתק ומעמיק שמדגיש בצורה ברורה את האתגרים החדשים בתחום אבטחת המידע. אין ספק שהשילוב של בינה מלאכותית באיומי הסייבר מחייב אותנו לחשוב מחדש על דרכי ההגנה ולהשקיע בטכנולוגיות חדשניות שיכולות לעמוד מול האיומים המתפתחים במהירות. תודה על התובנות החשובות!

תודה על הפוסט המעמיק! אכן, השילוב בין בינה מלאכותית לאיומי סייבר משנה לחלוטין את כללי המשחק ומחייב חשיבה חדשנית ותגובה מהירה. חשוב שנשקיע בפיתוח טכנולוגיות הגנה מתקדמות ונעדכן תהליכים ארגוניים כדי להישאר צעד אחד לפני התוקפים. המשך כך!

תוכן מרתק ומעמיק שמאיר נקודה קריטית בעולם אבטחת המידע של היום. בהחלט ברור שהבינה המלאכותית משנה את כללי המשחק, וחשוב שנשקיע בפיתוח טכנולוגיות הגנה חדשניות שיתמודדו עם האתגרים המורכבים הללו. תודה על השיתוף!

פוסט חשוב ומעמיק שמאיר נקודה קריטית בעידן הדיגיטלי שלנו. השילוב בין בינה מלאכותית לאיומי סייבר מחייב אותנו לחשוב מחוץ לקופסה ולפתח פתרונות חדשניים שיתמודדו עם האתגרים המשתנים. תודה על ההארה והקריאה לפעולה!

פוסט מעולה ומעמיק! החשיבה על האתגרים החדשים שמביאה הבינה המלאכותית לאבטחת הסייבר מאוד חשובה, במיוחד כשכלים מתוחכמים הופכים את ההתקפות ליותר מתוחכמות וממוקדות. בהחלט קריטי שנמשיך לפתח פתרונות חדשניים ולהיות ערניים לשינויים המתמידים בתחום. תודה על התובנות המעניינות!

פוסט מעורר מחשבה ומאוד רלוונטי לעידן הדיגיטלי שבו אנו חיים. חשוב להבין שהבינה המלאכותית משנה את חוקי המשחק בתחום אבטחת המידע, ולכן יש צורך בפיתוח פתרונות חדשניים ומותאמים שיתמודדו עם האיומים המתפתחים בצורה חכמה ויעילה. תודה על השיתוף!

תודה על הפוסט המעמיק! באמת, ההתפתחות המהירה של הבינה המלאכותית משנה לחלוטין את כללי המשחק בתחום אבטחת המידע. חשוב שנבין את האיומים החדשים ונשקיע בפיתוח כלים וטכנולוגיות מתקדמות כדי להישאר צעד אחד לפני התוקפים. רק כך נוכל להבטיח הגנה אמינה ומותאמת לעידן הדיגיטלי.

תודה על הפוסט המעמיק והחשוב! אכן, ההתפתחות המהירה של הבינה המלאכותית משנה לחלוטין את כללי המשחק בתחום אבטחת המידע. נדרש חשיבה יצירתית וחדשנית כדי לפתח פתרונות שיתמודדו עם האיומים המתוחכמים הללו, והמודעות לנושא היא הצעד הראשון בדרך להגנה אפקטיבית. כל הכבוד על ההעלאת הנושא המורכב והחיוני!

פוסט מרתק וחשוב! 🚀 אין ספק שהשימוש בבינה מלאכותית משנה את חוקי המשחק בעולם אבטחת המידע. ההתפתחות הטכנולוגית מביאה איתה אתגרים חדשים, ולכן חיוני לפתח כלים מתקדמים כדי להגן על מערכות וארגונים. תודה על השיתוף והעלאת המודעות לנושא הקריטי הזה! 🔐👏